Der kürzliche Diebstahl meiner Stimme brachte mich an eine neue Weggabelung in Bezug auf das Potenzial der KI, die Gesellschaft zu stören. Ich war so verblüfft von der Qualität der geklonten Stimme (und von dem äußerst cleveren und doch komödiantischen Stil eines meiner Kollegen), dass ich beschloss, dieselbe Software für "schändliche" Zwecke zu verwenden und zu sehen, wie weit ich gehen könnte, um ein kleines Unternehmen zu bestehlen - natürlich mit Erlaubnis! Spoiler-Alarm: Es war überraschend einfach durchzuführen und nahm kaum Zeit in Anspruch.

"KI wird wahrscheinlich entweder das Beste oder das Schlimmste sein, was der Menschheit passieren wird" - Stephen Hawking

Seitdem das Konzept der künstlichen Intelligenz in fiktionalen Filmen wie Blade Runner und The Terminator in den Mittelpunkt des Interesses gerückt ist, haben die Menschen die unendlichen Möglichkeiten, die diese Technologie bieten könnte, in Frage gestellt. Doch erst jetzt, mit leistungsfähigen Datenbanken, zunehmender Computerleistung und der Aufmerksamkeit der Medien, hat die KI ein weltweites Publikum in einer Weise erreicht, die gleichermaßen erschreckend und aufregend ist. Mit einer Technologie wie der KI, die sich unter uns herumtreibt, ist es sehr wahrscheinlich, dass es zu kreativen und ziemlich raffinierten Angriffen mit schädlichen Folgen kommen wird.

Eskapade des Stimmenklonens

Meine frühere Tätigkeit bei der Polizei hat mir die Einstellung vermittelt, wie ein Krimineller zu denken. Dieser Ansatz hat einige sehr greifbare und doch unterschätzte Vorteile: Je mehr man wie ein Krimineller denkt und sogar handelt (ohne tatsächlich einer zu werden), desto besser kann man sich schützen. Dies ist unerlässlich, um mit den neuesten Bedrohungen Schritt zu halten und künftige Trends vorauszusehen.

Um also einige der aktuellen Fähigkeiten der KI zu testen, musste ich wieder einmal in die Denkweise eines digitalen Kriminellen schlüpfen und ein Unternehmen auf ethische Weise angreifen!

Vor kurzem habe ich einen meiner Kontakte - nennen wir ihn Harry - gefragt, ob ich seine Stimme klonen und für einen Angriff auf sein Unternehmen verwenden könnte. Harry stimmte zu und erlaubte mir, das Experiment zu beginnen, indem ich mit einer leicht erhältlichen Software einen Klon seiner Stimme erstellte. Zu meinem Glück war es relativ einfach, an Harrys Stimme heranzukommen - er nimmt oft kurze Videos auf, in denen er auf seinem YouTube-Kanal für sein Unternehmen wirbt, und so konnte ich einige dieser Videos zusammenfügen, um ein gutes Audio-Testfeld zu schaffen. Innerhalb weniger Minuten hatte ich einen Klon von Harrys Stimme erstellt, der für mich genau wie er klang, und ich konnte dann alles schreiben und es mit seiner Stimme wiedergeben lassen.

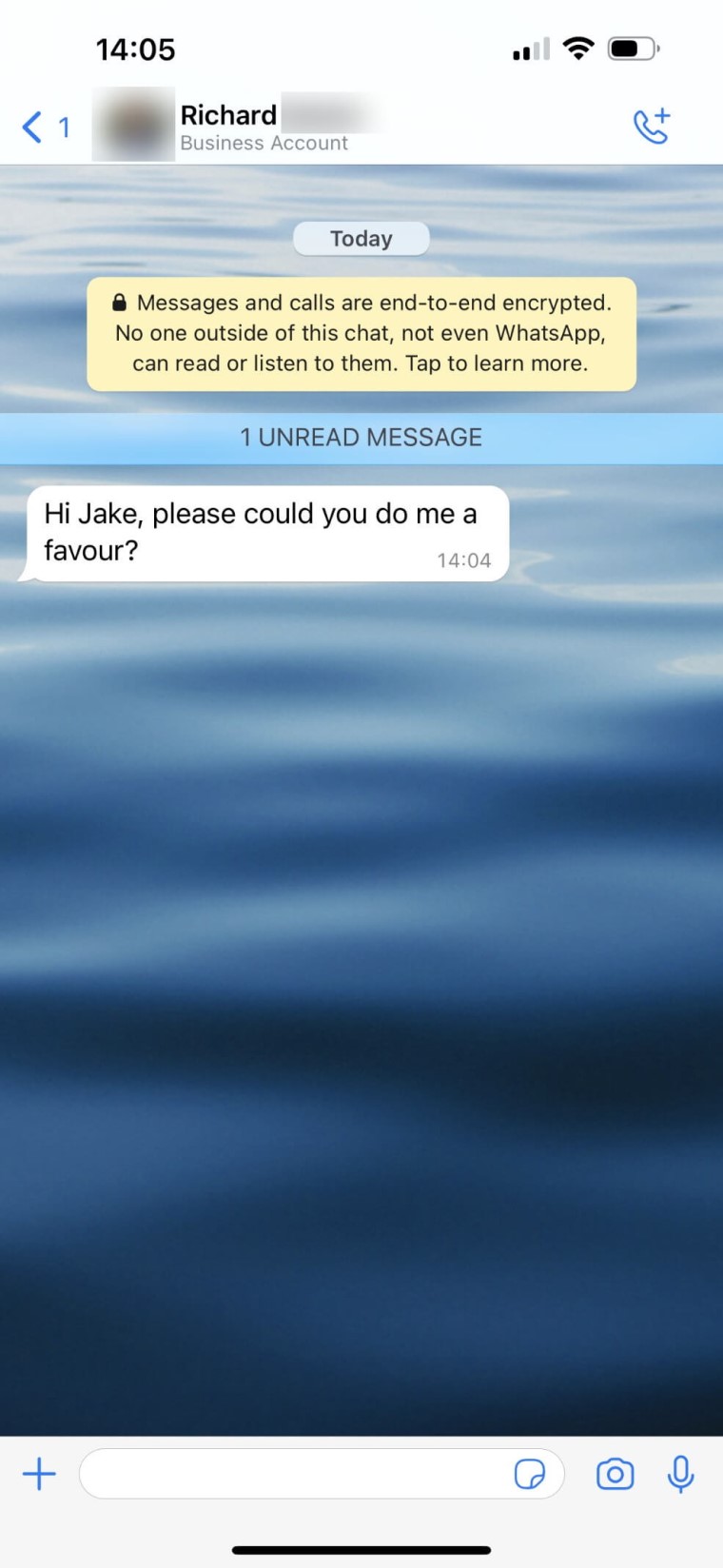

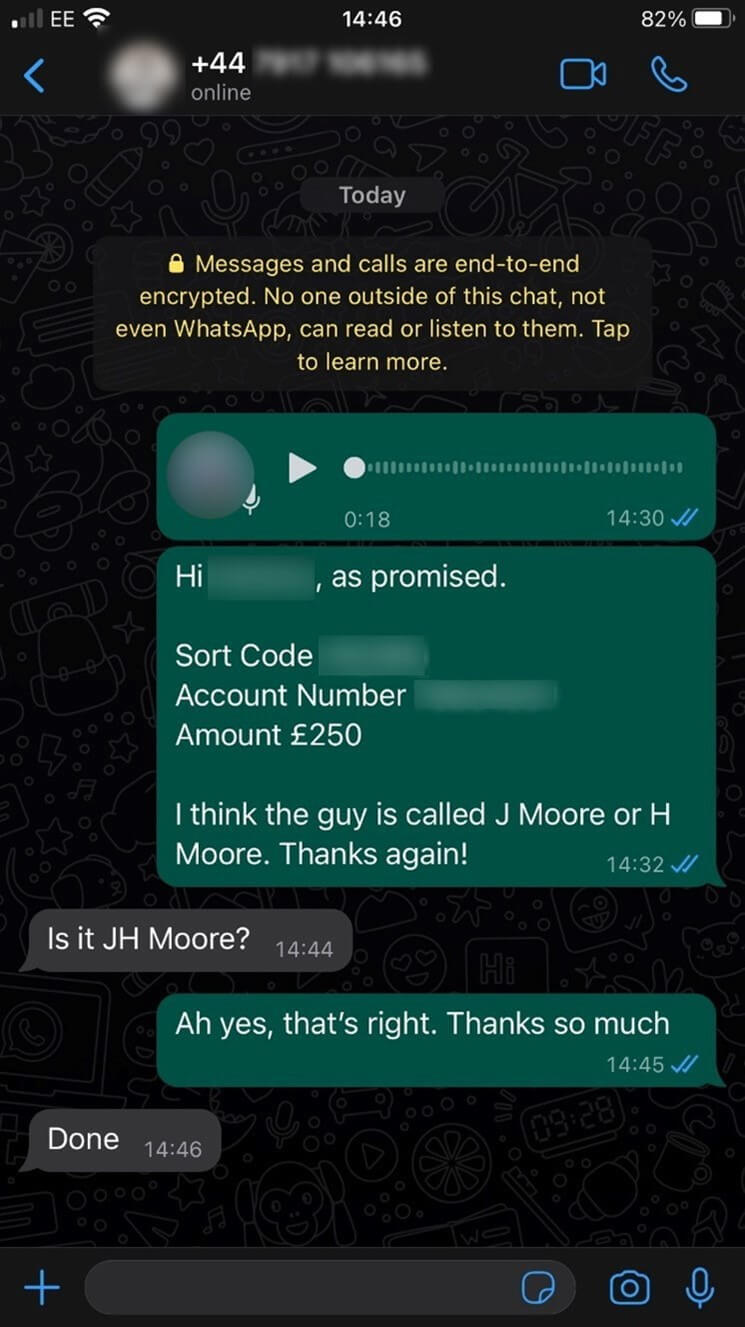

Um dem Angriff noch mehr Authentizität zu verleihen, beschloss ich, Harrys WhatsApp-Konto mit Hilfe eines SIM-Tausch-Angriffs zu stehlen - ebenfalls mit Genehmigung. Dann schickte ich eine Sprachnachricht von seinem WhatsApp-Konto an die Finanzdirektorin seines Unternehmens - nennen wir sie Sally - und forderte eine Zahlung von 250 £ an einen "neuen Auftragnehmer". Zum Zeitpunkt des Angriffs wusste ich, dass er sich auf einer nahe gelegenen Insel zu einem Geschäftsessen aufhielt, was mir die perfekte Geschichte und Gelegenheit zum Zuschlagen bot.

In der Sprachnachricht teilte er mir mit, wo er sich aufhielt und dass er die Bezahlung des "Grundrissplaners" benötigte, und sagte, er würde die Bankdaten sofort separat übermitteln. Damit war der Klang seiner Stimme zusätzlich zu der Sprachnachricht in Sallys WhatsApp-Thread verifiziert, was ausreichte, um sie davon zu überzeugen, dass die Anfrage echt war. Innerhalb von 16 Minuten nach der ersten Nachricht hatte ich 250 £ auf mein persönliches Konto überwiesen.

Ich muss zugeben, dass ich schockiert war, wie einfach es war und wie schnell es mir gelang, Sally davon zu überzeugen, dass Harrys geklonte Stimme echt war.

Dieses Maß an Manipulation funktionierte aufgrund einer überzeugenden Anzahl von miteinander verbundenen Faktoren:

- die Telefonnummer des Geschäftsführers verifizierte ihn,

- die von mir erfundene Geschichte passte zu den Ereignissen des Tages, und

- die Sprachnachricht hörte sich natürlich wie der Chef an.

In meiner Nachbesprechung mit dem Unternehmen und im Nachhinein stellte Sally fest, dass sie der Meinung war, dies sei "mehr als genug" an Verifizierung, um die Anfrage auszuführen. Natürlich hat das Unternehmen seitdem weitere Sicherheitsvorkehrungen getroffen, um seine Finanzen zu schützen. Und natürlich habe ich die 250 £ zurückerstattet!

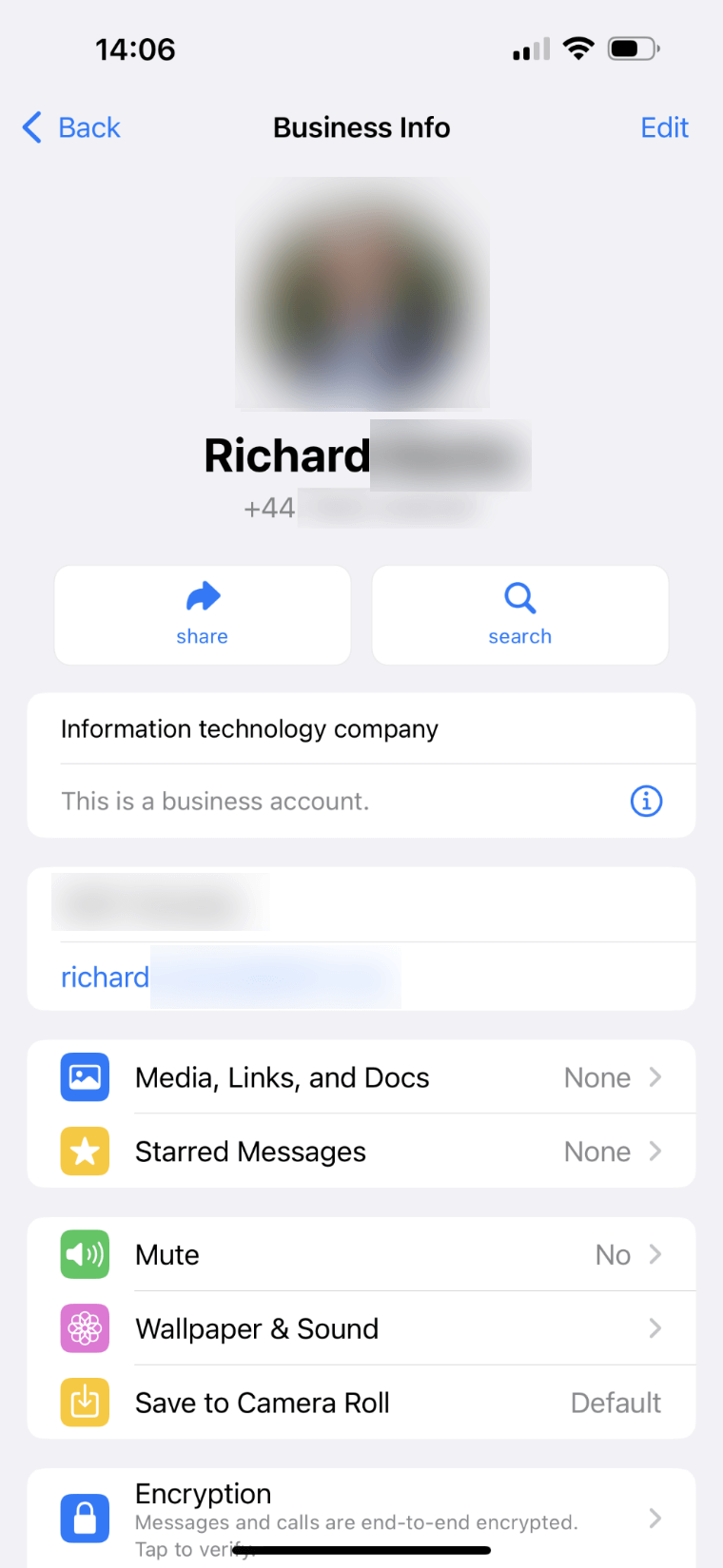

WhatsApp Business-Identität

DerDiebstahl des WhatsApp-Kontos einer anderen Person durch einen SIM-Tausch-Angriff könnte ein ziemlich langwieriger Weg sein, um einen Angriff glaubwürdiger zu machen, aber er kommt viel häufiger vor, als Sie vielleicht denken. Cyberkriminelle müssen sich jedoch nicht so viel Mühe geben, um das gleiche Ergebnis zu erzielen.

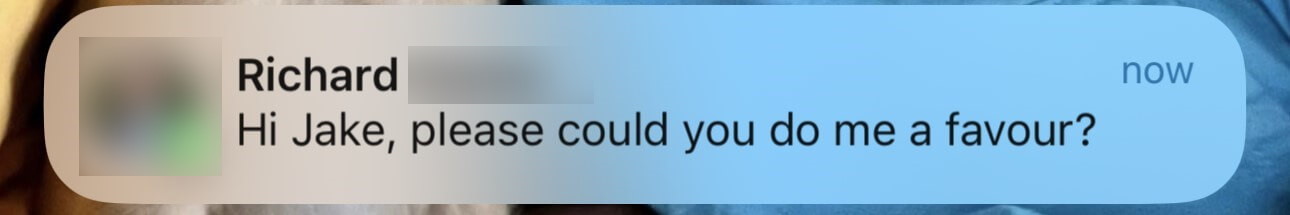

Ich wurde zum Beispiel kürzlich Ziel eines Angriffs, der auf den ersten Blick glaubwürdig wirkte. Jemand hatte mir eine WhatsApp-Nachricht geschickt, die angeblich von einem Freund von mir stammte, der in einem IT-Unternehmen arbeitet.

Das Interessante daran war, dass ich zwar gewohnt bin, Informationen zu verifizieren, diese Nachricht aber mit dem verlinkten Namen des Kontakts ankam, anstatt dass er als Nummer angezeigt wurde. Dies war von besonderem Interesse, da ich die Nummer, von der die Nachricht kam, nicht in meiner Kontaktliste gespeichert hatte und ich davon ausging, dass sie weiterhin als Handynummer und nicht als Name angezeigt werden würde.

Offensichtlich haben sie es geschafft, indem sie einfach ein WhatsApp-Business-Konto erstellt haben, das es ermöglicht, einen beliebigen Namen, ein Foto und eine E-Mail-Adresse zu einem Konto hinzuzufügen, so dass es sofort echt aussieht. Kombiniert man dies mit dem Klonen von KI-Stimmen, sind wir in der nächsten Generation des Social Engineering angekommen.

Zum Glück wusste ich von Anfang an, dass es sich um einen Betrug handelte, aber viele Menschen könnten auf diesen einfachen Trick hereinfallen, der letztlich zur Freigabe von Geld in Form von Finanztransaktionen, Prepaid-Karten oder anderen Karten wie der Apple Card führen könnte, die alle bei Cyberdieben beliebt sind.

Da das maschinelle Lernen und die künstliche Intelligenz sprunghaft voranschreiten und in letzter Zeit zunehmend für die breite Masse verfügbar werden, bewegen wir uns auf ein Zeitalter zu, in dem die Technologie beginnt, den Kriminellen effizienter als je zuvor zu helfen, unter anderem durch die Verbesserung aller bestehenden Tools, die dazu beitragen, die Identitäten und Aufenthaltsorte der Kriminellen zu verschleiern.

Sicher bleiben

Um auf unsere Experimente zurückzukommen, hier einige grundlegende Vorsichtsmaßnahmen, die Unternehmer ergreifen sollten, um zu vermeiden, dass sie Opfer von Angriffen werden, die das Klonen von Stimmen und andere Tricks nutzen:

- Nehmen Sie keine Abkürzungen bei den Unternehmensrichtlinien

- Überprüfen Sie Personen und Prozesse; überprüfen Sie z. B. alle Zahlungsanforderungen mit der Person, die (angeblich) die Anforderung stellt, und lassen Sie so viele Überweisungen wie möglich von zwei Mitarbeitern abzeichnen

- Halten Sie sich über die neuesten Technologietrends auf dem Laufenden und aktualisieren Sie die Schulungs- und Abwehrmaßnahmen entsprechend

- Führen Sie Ad-hoc-Schulungen zur Sensibilisierung aller Mitarbeiter durch

- Verwendung einer mehrschichtigen Sicherheitssoftware

Im Folgenden finden Sie einige Tipps, wie Sie sich vor SIM-Swap-Angriffen und anderen Angriffen schützen können, die darauf abzielen, Sie von Ihren persönlichen Daten oder Ihrem Geld zu trennen:

- Begrenzen Sie die persönlichen Informationen, die Sie online weitergeben; vermeiden Sie es nach Möglichkeit, Details wie Ihre Adresse oder Telefonnummer zu veröffentlichen

- Begrenzen Sie die Anzahl der Personen, die Ihre Beiträge oder andere Materialien in sozialen Medien sehen können

- Achten Sie auf Phishing-Angriffe und andere Versuche, die Sie dazu verleiten, Ihre sensiblen persönlichen Daten preiszugeben

- Wenn Ihr Telefonanbieter einen zusätzlichen Schutz für Ihr Telefonkonto anbietet, wie z. B. einen PIN-Code oder einen Passcode, sollten Sie diesen nutzen

- Verwenden Sie die Zwei-Faktoren-Authentifizierung (2FA), insbesondere eine Authentifizierungs-App oder ein Hardware-Authentifizierungsgerät

Die Bedeutung der 2FA kann gar nicht hoch genug eingeschätzt werden - stellen Sie sicher, dass Sie sie auch für Ihr WhatsApp-Konto (wo sie als Zwei-Schritt-Verifizierung bezeichnet wird) und alle anderen Online-Konten, die sie anbieten, aktivieren.